- 股票掌故

- 香港股票資訊

- 神州股票資訊

- 台股資訊

- 博客好文

- 文庫舊文

- 香港股票資訊

- 第一財經

- 微信公眾號

- Webb哥點將錄

- 港股專區

- 股海挪亞方舟

- 動漫遊戲音樂

- 好歌

- 動漫綜合

- RealBlog

- 測試

- 強國

- 潮流潮物 [Fashion board]

- 龍鳳大茶樓

- 文章保管庫

- 財經人物

- 智慧

- 世界之大,無奇不有

- 創業

- 股壇維基研發區

- 英文

- 財經書籍

- 期權期指輪天地

- 郊遊遠足

- 站務

- 飲食

- 國際經濟

- 上市公司新聞

- 美股專區

- 書藉及文章分享區

- 娛樂廣場

- 波馬風雲

- 政治民生區

- 財經專業機構

- 識飲色食

- 即市討論區

- 股票專業討論區

- 全球政治經濟社會區

- 建築

- I.T.

- 馬後砲膠區之圖表

- 打工仔

- 蘋果專欄

- 雨傘革命

- Louis 先生投資時事分享區

- 地產

Random Tags

比特幣礦業史(上):故事的開始,CPU 時代 36氪

http://techorange.com/2013/05/22/bitcoin-mining-history-1/編按:本文作者張沈鵬為比特幣交易平台42btc.com和42qu.com的創始人,也是個神級程式工程師。以比特幣的歷史為題投稿至《36氪》,分為上、中、下三集刊出。如果想對比特幣的種種了解更多,42btc.com 上有更多說明。

2013 年 5 月19 日這一天,中國的比特幣節點有 85,220 個,雄霸全球,佔比 22.8%。美國有 75,258 個,排第二;德國有 30,395 個,排第三。

(數據來自http://bitnodes.io/)

- 0. 序

比特幣是電子黃金。有黃金就有淘金者。

比特幣的淘金者常自稱為網絡世界的「礦工(miner)」, 與時代另一大階層碼農(《TO》編按:指底層資淺程式設計師)交相輝映,構成了虛擬社會的工農階層。

時至今日,比特幣礦業界已經歷經三次產業革命,從無到有,從有到多,吸引了越來越多的圍觀群眾投身其中。

很多人相信,比特幣將引發信息革命之後的第四次產業革命 — 金融革命。很多人相信,比特幣必將改變金融業,就像當年互聯網改變了傳媒業那樣。

現在,請讓我們回首那些硝煙還未散盡的往事。

- 1. 故事的開始: CPU 時代

1.1 史前啟示錄

弗里德里希·馮·哈耶克(Friedrich von Hayek,1899~1992),20 世紀最偉大的經濟學家之一,1974 年諾貝爾經濟學獎獲得者,晚年寫了人生中的最後一本經濟學專著: 《貨幣的非國家化》 。

他在書中顛覆了正統的貨幣制度觀念:既然在一般商品、服務市場上自由競爭最有效率,那為什麼不能在貨幣領域引入自由競爭?

哈耶克提出了一個革命性建議:廢除中央銀行製度,允許私人發行貨幣,並自由競爭,這個競爭過程將會發現最好的貨幣。

本書出版後在西方引起強烈反響,由此引發的爭論至今沒有結束。

1.2 盤古開天地

千百年來,如何用最科學的方式來對財富進行計價,並以最經濟的方式來交易,是一個歷史難題。

在諾貝爾經濟學獎得主弗里德曼看來,太平洋小島雅浦島居民用在石幣上作記號的方式來交易,與美聯儲將黃金儲備賬單從一個抽屜移到另一個抽屜,本質並無不同。 為此他產生一個偉大的靈感:可以用計算機技術(數學)來建立比國家信用更可靠的貨幣體系。弗里德曼構思了一個自動化裝置,可以按程序來發行貨幣,從而避免各國央行無限制的開動他們的印刷機。

可是,怎麼來實現這一設想?怎樣去製造不可偽造的貨幣呢?

上個世紀 80 年代,一群天才程序員一起探討這一難題。

1982 年,大衛·喬姆(David Chaum)提出不可追踪的密碼學網絡支付系統。8 年後,他將此想法擴展為密碼學匿名現金系統,即 Ecash。

1998 年,戴偉(Wei Dai)的論文闡述了一種匿名的、分佈式的電子現金系統:b-money。

與此同時,尼克·薩博(Nick Szabo)發明了 Bitgold,提出工作量證明機制,用戶通過競爭性地解決數學難題,然後將解答的結果用加密算法串聯在一起公開發布,構建出一個產權認證系統。

哈爾·芬尼(Hal Finney)則把該機製完善為一種「可重複利用的工作量證明」。

2008 年 11 月 1 日,一個名不見經傳, 自稱中本聰(Satoshi Nakamoto)的網友, 在 metzdowd.com 的密碼學郵件組中發表了《比特幣:一種點對點的現金支付系統》闡述他對電子貨幣的新構想。

1.3 礦工第一人

對於中本聰的想法,當時,最好的反應也只是持懷疑態度的接受。密碼學研究人員已經看到太多低水平的新手想出來的宏偉計劃了。他們的本能反應就是懷疑。

不過,這份郵件引起一個人的注意:哈爾·芬尼。

哈爾·芬尼是在密碼圈成名已久的大牛,PGP 加密的作者之一。哈爾·芬尼早就構想過一種基於密碼學的貨幣。他甚至曾經嘗試創造過基於一種基於計算工作量的貨幣,名為 RPOW。

事實上,比特幣用到的核心技術之一,便是基於他當年提出的「可重複使用的工作量證明機制」。

而中本聰是一個發奮圖強的程序員。他不止提想法,他還寫代碼。

2009 年 1月 3日,他發布了 bitcoin 客戶端的第一版。

在接下來的幾天裡,哈爾·芬尼通過郵件向中本聰報告了不少 BUG,然後中本聰把它們一一搞定。

很快,比特幣軟件的運行非常穩定了。所以哈爾·芬尼就讓它自己運行著。那時候,挖幣的難度還只是 1,可以通過 CPU 輕易地得到塊,根本不需要 GPU。在接下來的幾個星期裡, 哈爾·芬尼開采了幾千個比特幣。

後來,哈爾·芬尼覺得運行 bitcoin 客戶端會導致計算機很燙,而且風扇的噪音也讓他感到困擾,於是就把軟件關閉了。

或許, 他沒有意識到,他會因此在歷史上留下自己的名字。

就像人們永遠會記得,貝爾發明電話時,第一句話是向他的助手喊道:

「沃森,快過來,我想見你。」

(待續……)

高通CPU驚現漏洞 全球超9億部Android設備受影響

據外媒報道,信息安全研究公司Check Point近期發現了高通處理器CPU中的4個漏洞。通過這些漏洞, 黑客可以完全控制受影響的智能設備。

Check Point研究人員表示,這些高風險的特權升級漏洞被稱作“Quadrooter”, 將影響超過9億部安卓設備。

黑客可以通過這些漏洞欺騙用戶安裝惡意應用,且不需要請求任何特別的權限 (大多數的Android手機不允許安裝谷歌應用商店之外的第三方應用程序 ,但攻擊者已通過漏洞植入了惡意應用)。在應用安裝後,黑客可以獲得根權限,隨後完全控制受影響的Android設備,包括其中的數據和硬件,例如攝像頭和麥克風。

谷歌自主品牌的Nexus 5X、Nexus 6和Nexus 6P,以及三星Galaxy S7和S7 Edge都受到這一漏洞的影響。近期發布的黑莓DTEK50盡管被稱作“最安全的Android智能手機”,也仍然沒有能擺脫這一漏洞。

谷歌發言人證實,修複這些漏洞的補丁要到9月份才會全面發布。

但由於高通公司已經向合作夥伴提供了代碼,手機制造商可能更快地向個人設備發布補丁。

【電子】風起於青萍之末:從CPU到GPU再到ASIC,起底人工智能計算芯片技術大躍遷

來源: http://www.ikuyu.cn/indexinfo?type=1&id=11455&summary=

人工智能——風起於青萍之末

從3月份智能機器人AlphaGo戰勝李世石,到近期谷歌的最新用於人工智能深度學習的芯片TPU曝光,一個千億級的市場應用逐漸從水底浮向了水面。我們將深度剖析,在人工智能領域,有可能爆發的芯片——GPU、FPGA、ASIC及相關的市場和公司。

1.1.人工智能——下一個千億級市場

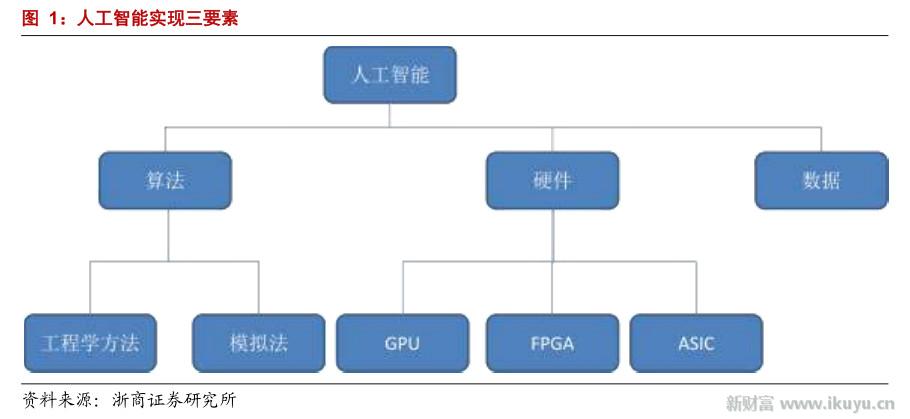

人工智能會成為未來的趨勢嗎?答案是會。人工智能,簡單地說,就是用機器去實現目前必須借助人類智慧才能實現的任務。人工智能包括三個要素:算法,計算和數據。

對人工智能的實現來說,算法是核心,計算、數據是基礎。在算法上來說,主要分為工程學法和模擬法。工程學方法是采用傳統的編程技術,利用大量數據處理經驗改進提升算法性能;模擬法則是模仿人類或其他生物所用的方法或者技能,提升算法性能,例如遺傳算法和神經網絡。而在計算能力來說,目前主要是使用GPU並行計算神經網絡,同時,FPGA和ASIC也將是未來異軍突起的力量。

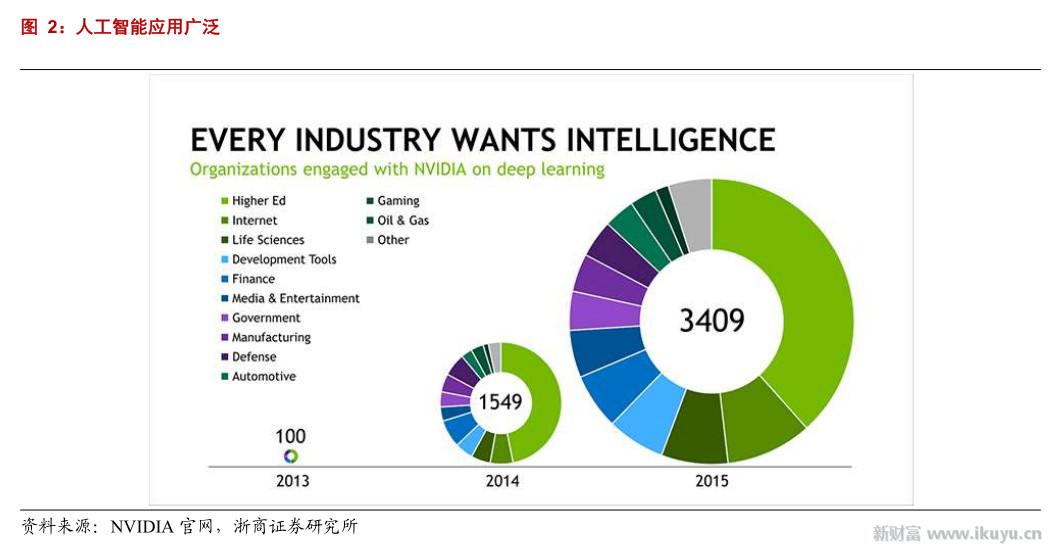

隨著百度,Google,Facebook,Microsoft等企業開始切入人工智能,人工智能可應用的領域非常廣泛。2013年100多家組織開始研發深度學習與人工智能,到2015年,短短2年間,研發機構已經迅速激增到3409家。可以看到,未來人工智能的應用將呈幾何級數的倍增。應用領域包括互聯網,金融,娛樂,政府機關,制造業,汽車,遊戲等。從產業結構來講,人工智能生態分為基礎、技術、應用三層。應用層包括人工智能+各行業(領域),技術層包括算法、模型及應用開發,基礎層包括數據資源和計算能力。

人工智能將在很多領域得到廣泛的應用。目前重點部署的應用有:語音識別,人臉識別,無人機,機器人,無人駕駛等。

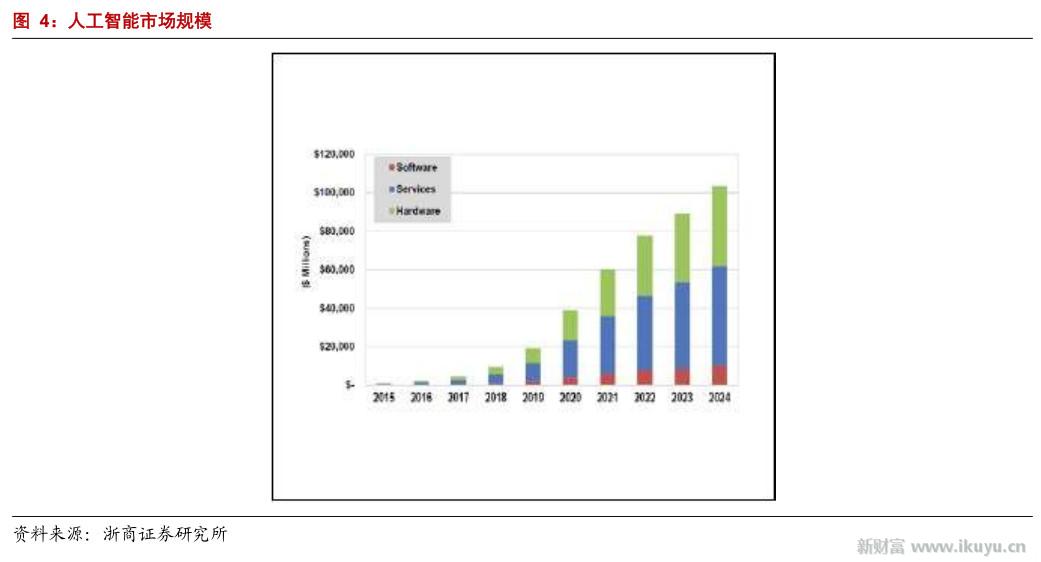

人工智能市場將保持高速增長,根據艾瑞咨詢的數據,2020年全球人工智能市場規模約1190億人民幣。而未來10年,人工智能將會是一個2000億美元的市場。空間非常巨大。其中在硬件市場方面,將會有30%的市場份額。

1.2.深度學習

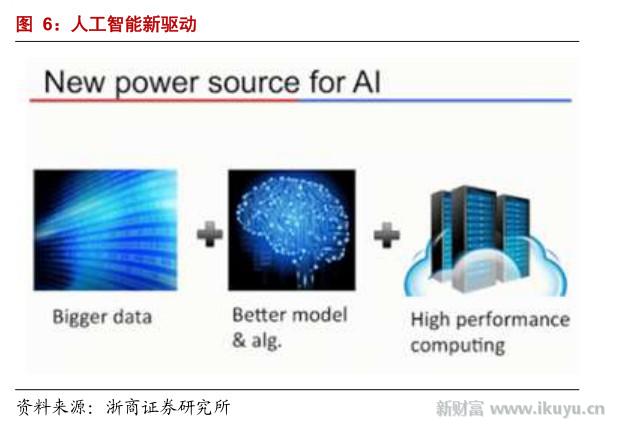

人工智能的核心是算法,深度學習是目前最主流的人工智能算法。深度學習在1958年就被提出,但直到最近,才真正火起來,主要原因在於:數據量的激增和計算機能力/成本。

深度學習是機器學習領域中對模式(聲音、圖像等等)進行建模的一種方法,它也是一種基於統計的概率模型。在對各種模式進行建模之後,便可以對各種模式進行識別了,例如待建模的模式是聲音的話,那麽這種識別便可以理解為語音識別。而類比來理解,如果說將機器學習算法類比為排序算法,那麽深度學習算法便是眾多排序算法當中的一種,這種算法在某些應用場景中,會具有一定的優勢。

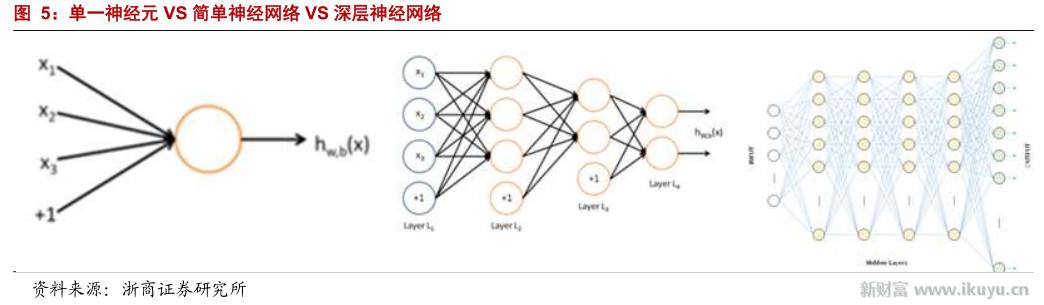

深度學習的學名又叫深層神經網絡(DeepNeuralNetworks),是從很久以前的人工神經網絡(ArtificialNeuralNetworks)模型發展而來。這種模型一般采用計算機科學中的圖模型來直觀的表達,而深度學習的“深度”便指的是圖模型的層數以及每一層的節點數量,相對於之前的神經網絡而言,有了很大程度的提升。

從單一的神經元,再到簡單的神經網絡,到一個用於語音識別的深層神經網絡。層次間的複雜度呈幾何倍數的遞增。

以圖像識別為例,圖像的原始輸入是像素,相鄰像素組成線條,多個線條組成紋理,進一步形成圖案,圖案構成了物體的局部,直至整個物體的樣子。不難發現,可以找到原始輸入和淺層特征之間的聯系,再通過中層特征,一步一步獲得和高層特征的聯系。想要從原始輸入直接跨越到高層特征,無疑是困難的。而整個識別過程,所需要的數據量和運算量是十分巨大的。2012年,由人工智能和機器學習頂級學者AndrewNg和分布式系統頂級專家JeffDean,用包含16000個CPU核的並行計算平臺訓練超過10億個神經元的深度神經網絡,在語音識別和圖像識別等領域取得了突破性的進展。該系統通過分析YouTube上選取的視頻,采用無監督的方式訓練深度神經網絡,可將圖像自動聚類。在系統中輸入“cat”後,結果在沒有外界幹涉的條件下,識別出了貓臉。可以看到,深度學習之所以能夠在今天得到重要的突破,原因在於:1海量的數據訓練2高性能的計算能力(CPU,GPU,FPGA,ASIC))。兩者缺一不可。

1.3.算力

衡量芯片計算性能的重要指標稱為算力。通常而言,將每秒所執行的浮點運算次數(亦稱每秒峰值速度)作為指標來衡量算力,簡稱為FLOPS。現有的主流芯片運算能力達到了TFLOPS級別。一個TFLOPS(teraFLOPS)等於每秒萬億(=10^12)次的浮點運算。

增加深度學習算力需要多個維度的齊頭並進的提升:1系統並行程度2時鐘的速度3內存的大小(包括register,cache,memory);4內存帶寬(memorybandwidth)5計算芯片同CPU之間的帶寬6還有各種微妙的硬件里的算法改進。

我們這篇報告將主要關註人工智能的芯片領域,著重討論GPU,FPGA,ASIC等幾種類型的芯片在人工智能領域的應用和未來的發展。

GPU——厚積薄發正當時

2.1.GPU簡介

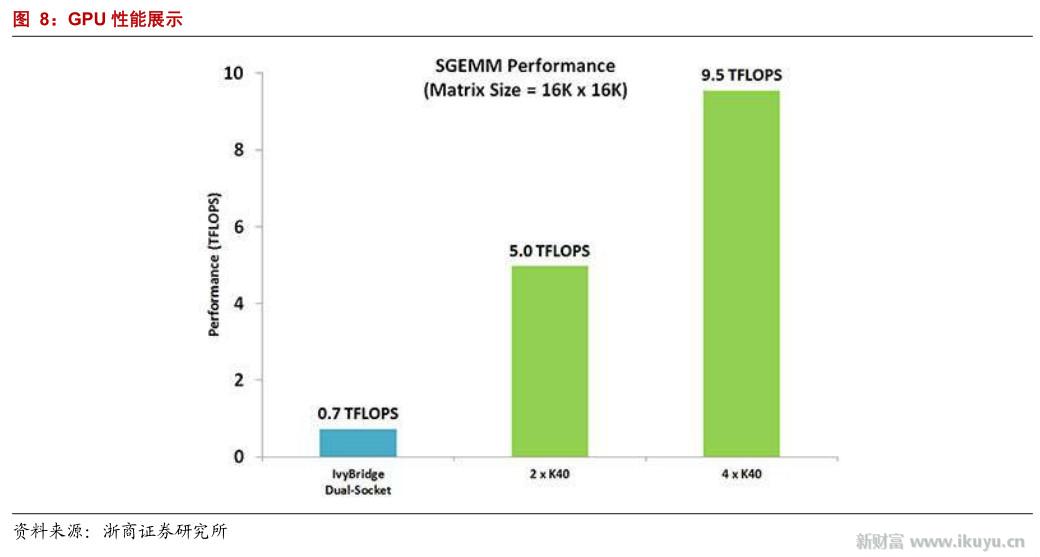

GPU,又稱顯示核心、視覺處理器、顯示芯片,是一種專門在個人電腦、工作站、遊戲機和一些移動設備(如平板電腦、智能手機等)上圖像運算工作的微處理器,與CPU類似,只不過GPU是專為執行複雜的數學和幾何計算而設計的,這些計算是圖形渲染所必需的。隨著人工智能的發展,如今的GPU已經不再局限於3D圖形處理了,GPU通用計算技術發展已經引起業界不少的關註,事實也證明在浮點運算、並行計算等部分計算方面,GPU可以提供數十倍乃至於上百倍於CPU的性能。

GPU的特點是有大量的核(多達幾千個核)和大量的高速內存,最初被設計用於遊戲,計算機圖像處理等。GPU主要擅長做類似圖像處理的並行計算,所謂的“粗粒度並行(coarse-grainparallelism)”。這個對於圖像處理很適用,因為像素與像素之間相對獨立,GPU提供大量的核,可以同時對很多像素進行並行處理。但這並不能帶來延遲的提升(而僅僅是處理吞吐量的提升)。比如,當一個消息到達時,雖然GPU有很多的核,但只能有其中一個核被用來處理當前這個消息,而且GPU核通常被設計為支持與圖像處理相關的運算,不如CPU通用。GPU主要適用於在數據層呈現很高的並行特性(data-parallelism)的應用,比如GPU比較適合用於類似蒙特卡羅模擬這樣的並行運算。

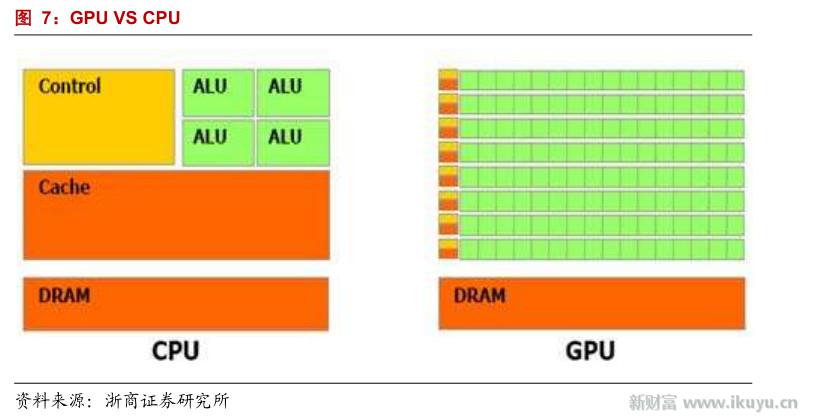

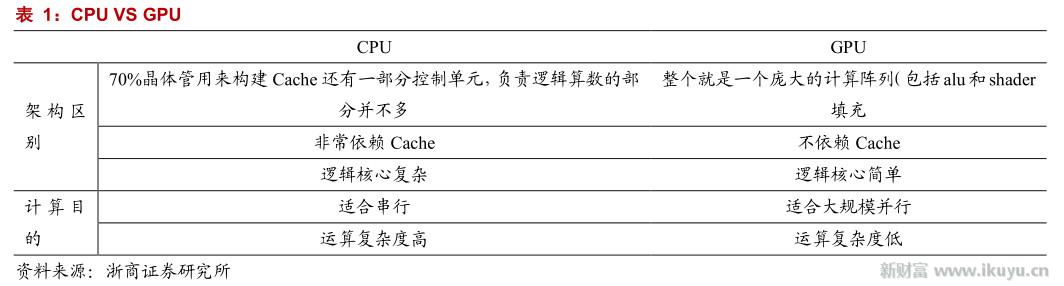

CPU和GPU本身架構方式和運算目的不同導致了CPU和GPU之間的不同,主要不同點列舉如下

正是因為GPU的特點特別適合於大規模並行運算,GPU在“深度學習”領域發揮著巨大的作用,因為GPU可以平行處理大量瑣碎信息。深度學習所依賴的是神經系統網絡——與人類大腦神經高度相似的網絡——而這種網絡出現的目的,就是要在高速的狀態下分析海量的數據。例如,如果你想要教會這種網絡如何識別出貓的模樣,你就要給它提供無數多的貓的圖片。而這種工作,正是GPU芯片所擅長的事情。而且相比於CPU,GPU的另一大優勢,就是它對能源的需求遠遠低於CPU。GPU擅長的是海量數據的快速處理。

工業與學術界的數據科學家已將GPU用於機器學習以便在各種應用上實現開創性的改進,這些應用包括圖像分類、視頻分析、語音識別以及自然語言處理等等。尤其是深度學習,人們在這一領域中一直進行大力投資和研究。深度學習是利用複雜的多級「深度」神經網絡來打造一些系統,這些系統能夠從海量的未標記訓練數據中進行特征檢測。

雖然機器學習已經有數十年的歷史,但是兩個較為新近的趨勢促進了機器學習的廣泛應用:海量訓練數據的出現以及GPU計算所提供的強大而高效的並行計算。人們利用GPU來訓練這些深度神經網絡,所使用的訓練集大得多,所耗費的時間大幅縮短,占用的數據中心基礎設施也少得多。GPU還被用於運行這些機器學習訓練模型,以便在雲端進行分類和預測,從而在耗費功率更低、占用基礎設施更少的情況下能夠支持遠比從前更大的數據量和吞吐量。

將GPU加速器用於機器學習的早期用戶包括諸多規模的網絡和社交媒體公司,另外還有數據科學和機器學習領域中一流的研究機構。與單純使用CPU的做法相比,GPU具有數以千計的計算核心、可實現10-100倍應用吞吐量,因此GPU已經成為數據科學家處理大數據的處理器。

綜上而言,我們認為人工智能時代的GPU已經不再是傳統意義上的圖形處理器,而更多的應該賦予專用處理器的頭銜,具備強大的並行計算能力。

2.2.王者歸來的NVIDIA

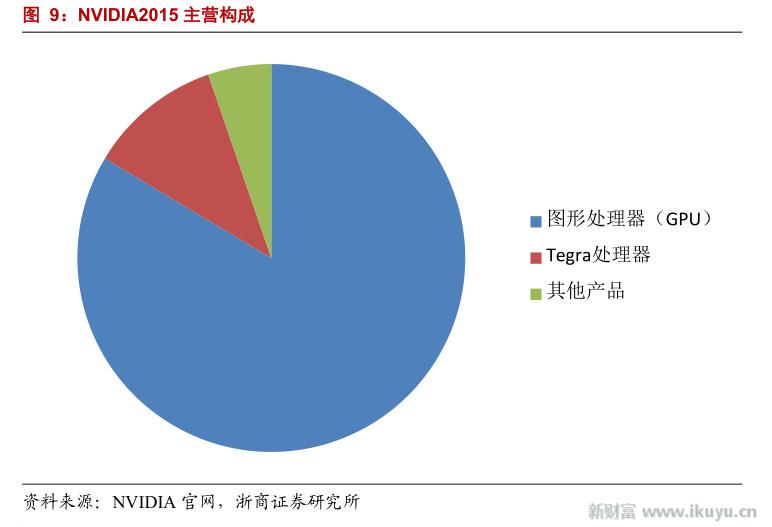

NVIDIA是一家以設計GPU芯片為主業的半導體公司。其主要產品包括遊戲顯卡GeForceGPU,工作站Quadro,可用於深度學習計算的TeslaGPU,為移動以及汽車處理設計TegraGPU。NVIDIA的產品在應用領域來劃分,主要包括圖形處理器(GPU),Tegra處理器(用於車載),以及其他。各塊業務所占比重如圖所示。

NVIDIA在最近12日發布的財報顯示,2016年第一財報季度內,公司整體利潤激增46%,至1.96億美元,營收同比增長13%至13.05億美元。財報公布後,NVIDIA股價一度大漲7.7%,盤中最高觸及38.81美元。

NVIDIA2011-2015年的營收和凈利潤如圖所示。從2013年起,業績明顯呈現出上升的勢頭。這個時間點其實也契合人工智能在深度學習領域開始使用GPU來進行大規模並行計算。2016年NVIDIA的一季報更是呈現出爆發的跡象,整體利潤激增46%,我們認為財報的數據是最有力的證明,GPU正在受益於人工智能深度學習的需求,而廣泛地得到應用。

NVIDIA的產品毛利率從2011年開始,保持了連續上升的勢頭。NVIDIA的核心產品是GPU,從毛利率水平不斷提升來看,NVIDIA的GPU產品始終保持了核心競爭力和更新換代的能力。產品的結構也在不斷優化,從獨立專顯到服務器再到大規模並行計算,隨著應用的不斷升級,產品的結構也越來越優化。從毛利率水平看,NVIDIA的產品保持了不斷更新和競爭力。隨著並行計算在深度學習中的廣泛應用,NVIDIA的產品毛利率還將進一步提升。

在高性能計算機、深度學習、人工智能等領域,NVIDIA的Tesla芯片有十分關鍵的作用。NVIDIA的CUBA技術,大幅度提高了純CPU構成的超級計算機的性能。人工智能和深度學習需要大量的浮點計算,在高性能計算領域,GPU需求在不斷增強。目前NVIDIA的高性能顯卡已經占有84%的市場份額。亞馬遜的AWS,Facebook,Google等世界一級數據中心都需要用NVIDIA的Tesla芯片,隨著雲計算和人工智能的不斷發展,我們認為NVIDIA的高性能GPU也能在未來5年保持20%以上的增長速度。

2.3.GPU國內行業現狀及公司

國內在GPU芯片設計方面,還處於起步階段,與國際主流產品尚有一定的差距。不過星星之火,可以燎原。有一些企業,逐漸開始擁有自主研發的能力,比如國內企業景嘉微。景嘉微擁有國內首款自主研發的GPU芯片JM5400,專用於公司的圖形顯控領域。JM5400為代表的圖形芯片打破外國芯片在我國軍用GPU領域的壟斷,率先實現軍用GPU國產化。

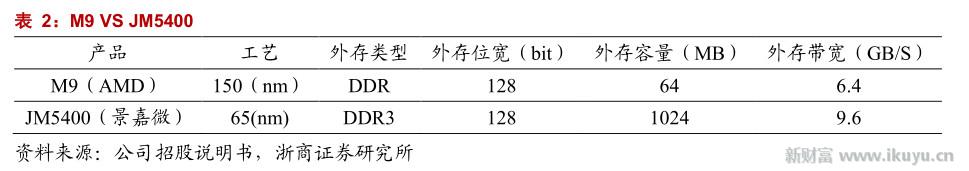

公司的GPUJM5400主要替代AMD的GPUM9,兩者在性能上的比較如下。相比而言,公司的JM5400具有功耗低,性能優的優勢。

雖然景嘉微的GPU芯片主要用於軍用顯示,尚無法達到人工智能深度學習的算力要求,但隨著研發和支持的投入,參照NVIDIA當年的發展歷史,景嘉微也會有潛力成長起來。

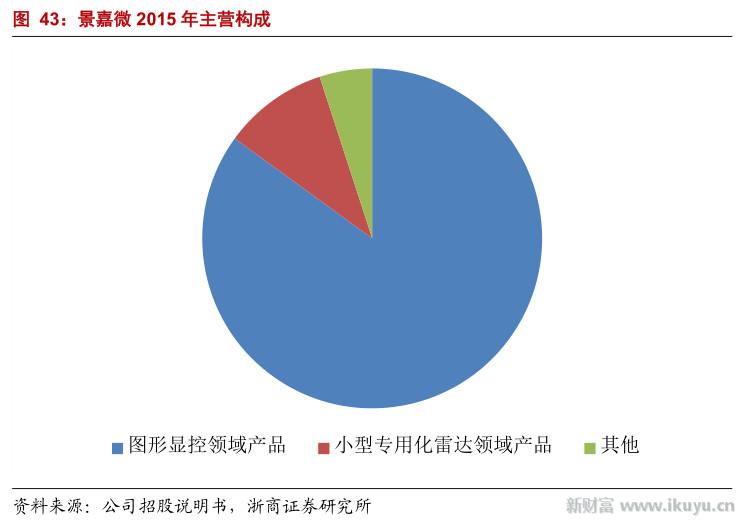

分析景嘉微的主營構成,主要分為圖形顯控領域產品、小型專用化雷達領域產品,以及其他。其中圖形顯控領域產品占公司收入的85%多。公司的主要下遊客戶是軍用飛機,目前我國大多數軍用飛機都使用公司的圖形顯空產品

公司從2012-2015年的營收和凈利潤都保持穩定的成長,呈現出向上的趨勢。隨著公司國產GPU的量產和替代,我們預計後續產品的營收和凈利潤將會得到進一步的提升。

我們認為,國內的GPU發展尚處於起步階段,目前的產品還是主要用於於GPU原先的圖形顯控領域,雖然還不能跟現在人工智能深度學習所需要的GPU所媲美,但走在正確方向的道路上,未來也有可能得到突破。

FPGA——“萬能芯片”在人工智能時代複蘇

FPGA(Field-ProgrammableGateArray),即現場可編程門陣列,它是在PAL、GAL、CPLD等可編程器件的基礎上進一步發展的產物。FPGA芯片主要由6部分完成,分別為:可編程輸入輸出單元、基本可編程邏輯單元、完整的時鐘管理、嵌入塊式RAM、豐富的布線資源、內嵌的底層功能單元和內嵌專用硬件模塊。

FPGA還具有靜態可重複編程和動態在系統重構的特性,使得硬件的功能可以像軟件一樣通過編程來修改。FPGA能完成任何數字器件的功能,甚至是高性能CPU都可以用FPGA來實現。

Intel在在2015年以161億美元收購了FPGA龍頭Altera,其目的之一也是看中FPGA的專用計算能力在未來人工智能領域的發展。

3.1.FPGA——高性能、低功耗的可編程芯片

FPGA之所以能有潛力成為人工智能深度學習方面的計算工具,主要原因就在於其本身特性:可編程專用性,高性能,低功耗。

先來看一下FPGA的內部架構。FPGA擁有大量的可編程邏輯單元,可以根據客戶定制來做針對性的算法設計。除此以外,在處理海量數據的時候,FPGA相比於CPU和GPU,獨到的優勢在於:FPGA更接近IO。換句話說,FPGA是硬件底層的架構。比如,數據采用GPU計算,它先要進入內存,並在CPU指令下拷入GPU內存,在那邊執行結束後再拷到內存被CPU繼續處理,這過程並沒有時間優勢;而使用FPGA的話,數據I/O接口進入FPGA,在里面解幀後進行數據處理或預處理,然後通過PCIE接口送入內存讓CPU處理,一些很底層的工作已經被FPGA處理完畢了(FPGA扮演協處理器的角色),且積累到一定數量後以DMA形式傳輸到內存,以中斷通知CPU來處理,這樣效率就高得多。

專用計算領域強過CPU

雖然FPGA的頻率一般比CPU低,但CPU是通用處理器,做某個特定運算(如信號處理,圖像處理)可能需要很多個時鐘周期,而FPGA可以通過編程重組電路,直接生成專用電路,加上電路並行性,可能做這個特定運算只需要一個時鐘周期。比如一般CPU每次只能處理4到8個指令,在FPGA上使用數據並行的方法可以每次處理256個或者更多的指令,讓FPGA可以處理比CPU多很多的數據量。舉個例子,CPU主頻3GHz,FPGA主頻200MHz,若做某個特定運算CPU需要30個時鐘周期,FPGA只需一個,則耗時情況:CPU:30/3GHz=10ns;FPGA:1/200MHz=5ns。可以看到,FPGA做這個特定運算速度比CPU塊,能幫助加速。

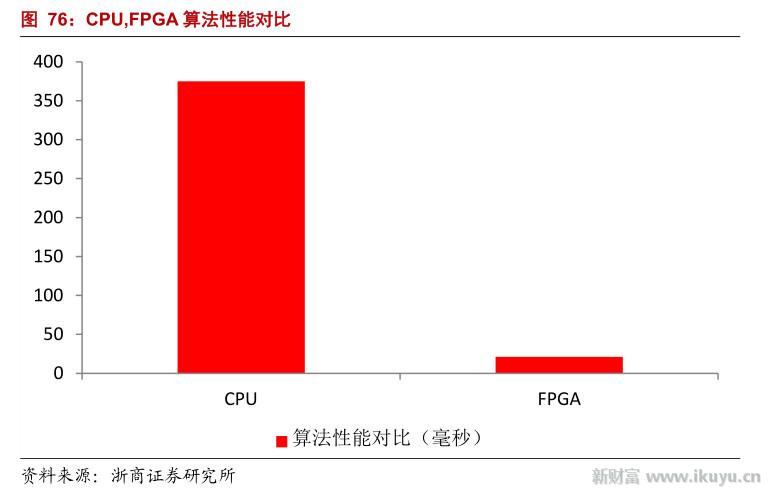

北京大學與加州大學的一個關於FPGA加速深度學習算法的合作研究。展示了FPGA與CPU在執行深度學習算法時的耗時對比。在運行一次叠代時,使用CPU耗時375毫秒,而使用FPGA只耗時21毫秒,取得了18倍左右的加速比

能耗顯著降低

FPGA相對於CPU與GPU有明顯的能耗優勢,主要有兩個原因。首先,在FPGA中沒有取指令與指令譯碼操作,在Intel的CPU里面,由於使用的是CISC架構,僅僅譯碼就占整個芯片能耗的50%;在GPU里面,取指令與譯碼也消耗了10%~20%的能耗。其次,FPGA的主頻比CPU與GPU低很多,通常CPU與GPU都在1GHz到3GHz之間,而FPGA的主頻一般在500MHz以下。如此大的頻率差使得FPGA消耗的能耗遠低於CPU與GPU。

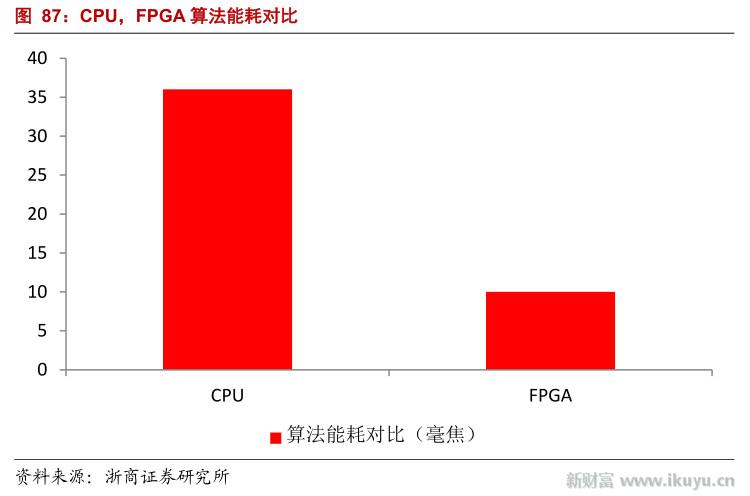

FPGA與CPU在執行深度學習算法時的耗能對比。在執行一次深度學習運算,使用CPU耗能36焦,而使用FPGA只耗能10焦,取得了3.5倍左右的節能比。通過用FPGA加速與節能,讓深度學習實時計算更容易在移動端運行。

相比CPU和GPU,FPGA憑借比特級細粒度定制的結構、流水線並行計算的能力和高效的能耗,在深度學習應用中展現出獨特的優勢,在大規模服務器部署或資源受限的嵌入式應用方面有巨大潛力。此外,FPGA架構靈活,使得研究者能夠在諸如GPU的固定架構之外進行模型優化探究。

3.2.Intel收購Altera分析

眾所周知,在深度神經網絡計算中運用CPU、GPU已不是什麽新鮮事。雖然Xilinx公司早在1985年就推出了第一款FPGA產品XC2064,但該技術真正應用於深度神經網絡還是近幾年的事。英特爾167億美元收購Altera,IBM與Xilinx的合作,都昭示著FPGA領域的變革,未來也將很快看到FPGA與個人應用和數據中心應用的整合。

目前而言,FPGA的應用領域以當前的通信、圖像處理、IC原型驗證、汽車電子、工業等為主。整個FPGA市場由Xilinx和Altera主導,兩者共同占有85%的市場份額。FPGA市場規模預計在2016年將達到60億美元,並保持年複合增速9%。

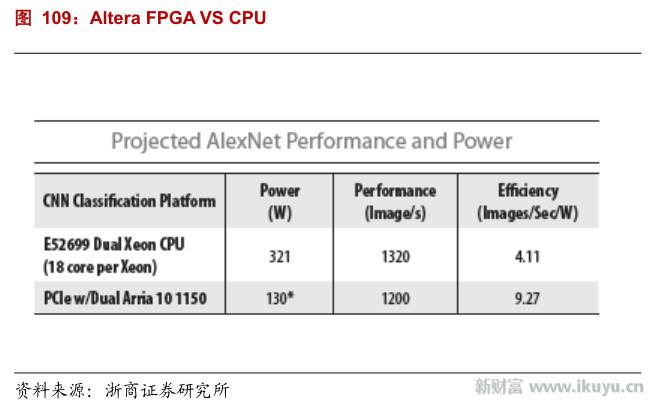

根據Altera內部文件顯示,Altera很早就在研發使用FPGA針對深度學習算法的應用,並在2015年Intel的論壇上展示了產品的性能。結論是在功耗和性能上相對同等級的CPU,有較大的優勢。

我們認為,Intel之所以收購Altera,主要原因就在於看中人工智能的發展,但CPU在計算能力上的先天不足,讓其需要尋找一個合作夥伴。Altera的的FPGA正好彌補了CPU在這方面的缺陷,我們認為,CPU+FPGA在人工智能深度學習領域,將會是未來的一個重要發展方向。

3.3.FPGA國內行業與公司

FPGA整個市場被國外的兩大巨頭所寡占,Xilinx和Altera占了85%的份額。國內目前也有一些公司在FPGA領域有所建樹,其中比較優秀的有同方國芯。

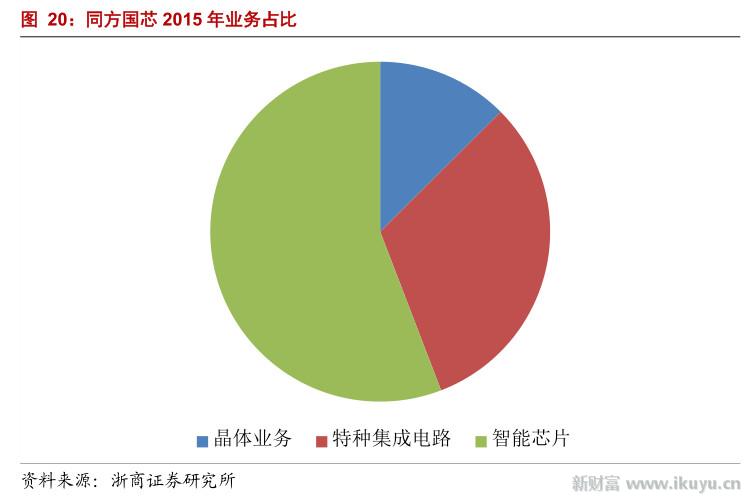

同方國芯的主營業務包括晶體業務,特種集成電路,智能芯片這幾塊。各業務所占比重如下:

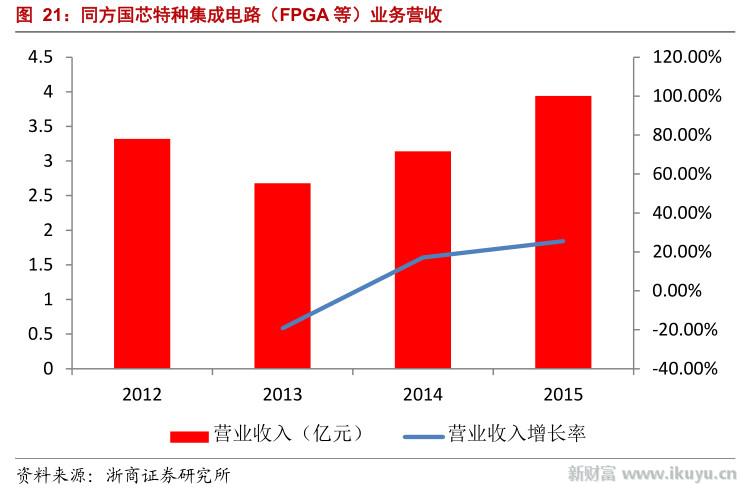

同方國芯的FPGA歸屬於特種集成電路業務,我們統計上市以來這塊業務的營收狀況,保持著非常迅速的增長,年複合增速在20%左右。

同時,特種集成電路的毛利率也一直維持在很高的水準,並持續往上升。我們預計隨著FPGA在人工智能深度學習領域的應用增長,還會給公司帶來持續性的利好增長。

ASIC——後起之秀,不可估量

4.1.性能與功耗完美結合的ASIC

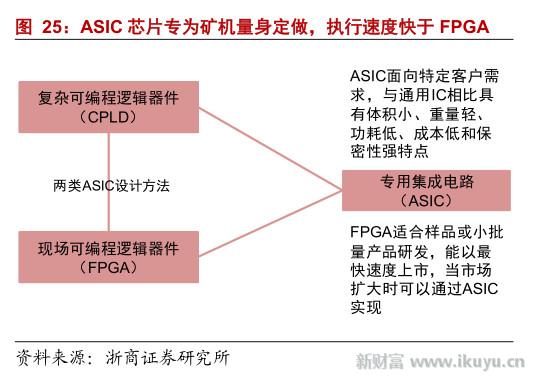

ASIC(ApplicationSpecificIntegratedCircuits,專用集成電路),是指應特定用戶要求或特定電子系統的需要而設計、制造的集成電路。嚴格意義上來講,ASIC是一種專用芯片,與傳統的通用芯片有一定的差異。是為了某種特定的需求而專門定制的芯片。

ASIC作為集成電路技術與特定用戶的整機或系統技術緊密結合的產物,與通用集成電路相比,具有以下幾個方面的優越性:體積更小、功耗更低、可靠性提高、性能提高、保密性增強、成本降低。

回到深度學習最重要的指標:算力和功耗。我們對比NVIDIA的GK210和某ASIC芯片規劃的指標,如下所示

從算力上來說,ASIC產品的計算能力是GK210的2.5倍。第二個指標是功耗,功耗做到了GK210的1/15。第三個指標是內部存儲容量的大小及帶寬。這個內部MEMORY相當於CPU上的CACHE。深度雪地的模型比較大,通常能夠到幾百MB到1GB左右,會被頻繁的讀出來,如果模型放在片外的DDR里邊,對DDR造成的帶寬壓力通常會到TB/S級別。

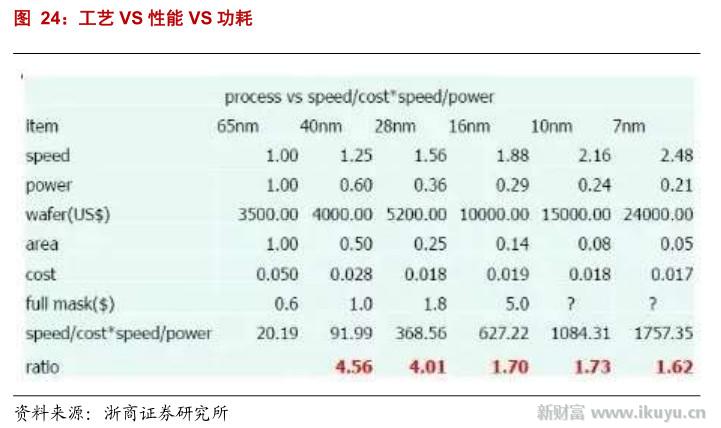

因為全定制芯片ASIC綜合考慮了工藝和性能方面的權衡,隨著工藝的進步,性能和價格的進展如下:

全定制設計的ASIC,因為其自身的特性,相較於非定制芯片,擁有以下幾個優勢:

●同樣工藝,同樣功能,第一次采用全定制設計性能提高7.6倍

●普通設計,全定制和非全定制的差別可能有1~2個數量級的差異

●采用全定制方法可以超越非全定制4個工藝節點(采用28nm做的全定制設計,可能比5nm做的非全定制設計還要好)

我們認為,ASIC的優勢,在人工智能深度學習領域,具有很大的潛力。

4.2.從“比特幣挖礦機ASIC發展”推導“ASIC在人工智能領域大有可為”

ASIC在人工智能深度學習方面的應用還不多,但是我們可以拿比特幣礦機芯片的發展做類似的推理。比特幣挖礦和人工智能深度學習有類似之處,都是依賴於底層的芯片進行大規模的並行計算。而ASIC在比特幣挖礦領域,展現出了得天獨厚的優勢。

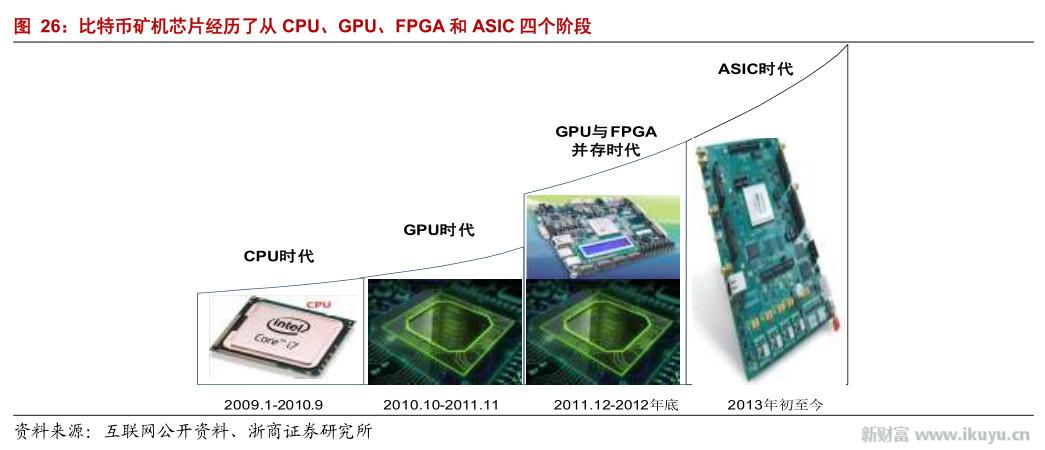

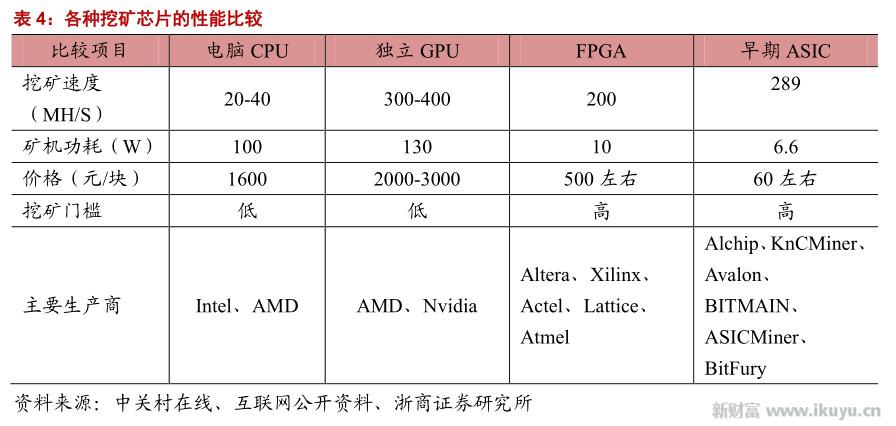

比特幣礦機的芯片經歷了四個階段:CPU、GPU、FPGA和ASIC。其中2009年1月比特幣創始人中本聰利用電腦CPU挖出了第一個創世塊,其後大約一年時間BTC網絡主要依靠CPU挖礦,CPU設計中需要大量的邏輯判斷和很強的通用性來處理不同類型的數據,而GPU處理簡單的SHA-256算法速度更具優勢;GPU由於采用了大量並行處理的核心架構,對於簡單的SHA256算法處理速度較快,2010年9月挖礦進入了GPU時代,但是GPU也存在功耗高、搭建部署困難的缺陷,不適合大規模部署;2011年12月出現了基於FPGA芯片的挖礦設備,其功耗為同類型的GPU的1/40,但是FPGA芯片價格昂貴、部署也很複雜,主要被少數具備專業背景的礦工所使用,這個階段FPGA和GPU成為挖礦的主力軍;2013年首臺基於ASIC芯片的Avalon礦機面世,挖礦進入了ASIC時代。ASIC芯片是專為挖礦量身定制的芯片,它將FPGA芯片中在挖礦時不會使用的功能去掉,與同等工藝的FPGA芯片相比執行速度塊,大規模生產後的成本也要低於FPGA芯片。

在CPU、GPU時代,挖礦門檻較低,家庭的普通臺式機或者帶有獨立顯卡的筆記本都可以用來挖礦,2012年以前挖礦還是大眾可以參與的相對公平對等階段;隨著FPGA、ASIC芯片的出現,挖礦逐漸開始向一些專業人士聚集。ASIC芯片是為挖礦量身定制的,與同等工藝的FPGA芯片相比ASIC芯片的執行速度更快,大規模生產後成本也會比FPGA芯片低。目前ASIC芯片已成為主流的礦機芯片,挖礦速度基本都達到了GH/S的級別,比如BITMAIN的第四代芯片BM1385,單顆芯片算力可達32.5GH/S,在0.66V的核心電壓下功耗僅為0.216W/GH/S。ASIC芯片隨著矽片加工精度的提升,其性能更好,功耗更低。目前矽片加工精度已經130nm提升至14nm,基本接近現有半導體技術的極限。

以上,從ASIC在比特幣挖礦機時代的發展歷史,可以看出ASIC在專用並行計算領域所具有的得天獨厚的優勢:算力高,功耗低,價格低,專用性強。的谷歌最近曝光的專用於人工智能深度學習計算的TPU,其實也是一款ASIC。

4.3.ASIC國內行業與公司

我們認為,國內的比特幣芯片生產廠商,都有可能在人工智能時代華麗轉身,成為擁抱深度學習的定制芯片供應商。在這塊領域有所深耕建樹的公司有,國內的深圳烤貓、迦南耘智、比特大陸和龍礦科技。擁有自產芯片的礦機生產商的盈利能力強,普遍的毛利率達到50%以上。

總結

綜上,我們的觀點:人工智能時代逐步臨近,GPU,FPGA,ASIC這幾塊傳統領域的芯片,將在人工智能時代迎來新的爆發。風起於青萍之末,一起關註人工智能時代芯片的大機會!

(完)

股市有風險,投資需謹慎。本文僅供受眾參考,不代表任何投資建議,任何參考本文所作的投資決策皆為受眾自行獨立作出,造成的經濟、財務或其他風險均由受眾自擔。

新財富酷魚正在積極建立和讀者、合作夥伴的聯系,你想獲取更多有價值資訊嗎?你想成為我們網站的作者嗎?你對我們的網站的更新有什麽建議?請掃描以下二維碼聯系我們的主編(本微信號不洽談廣告投放事宜,加的時候請註明“新財富+您所在公司”):

【網上爆Post】十核CPU配6GB RAM手機 平過iPhone SE

1 : GS(14)@2016-03-30 14:43:41金屬機身外殼,機背配有21MP Sony IMX230鏡頭。

神州大地無奇不有,當大家還在研究新iPhone SE內置2GB RAM速度表現如何、1,200萬像素的拍攝質素時,國內一家新手機品牌Vernee已宣布將推出一支內置10核CPU、內置6GB RAM及配備21MP Sony IMX230鏡頭的高階手機Vernee Apollo,而最屈機的是,此機將定價為399.99美元(港幣約$3,100),比iPhone SE16GB容量還要便宜。

Apollo是Vernee首款推出的手機,除配備MediaTek Helio X20十核處理器、6GB RAM及128GB儲存容量外,還支援21MP Sony IMX230主鏡頭及8MP前置鏡頭。此機設有5.5寸屏幕,支援類似3D Touch的壓力感應觸控功能,其他規格還包括USB-C接口、指紋辨認系統及預載Android6.0平台等,規格強勁。傳聞即將上市的Samsung Galaxy Note6將內置6GB RAM,不過定價肯定不會是399.99美元。若Vernee Apollo真的在港上市,香港人又有冇興趣呢?資料來源:i4u記者:陳詠兒

來源: http://hk.apple.nextmedia.com/su ... t/20160330/19549385

Next Page